oneapi中配置ollama模型,报错如图 #533

Labels

No Label

bug

duplicate

enhancement

help wanted

invalid

question

wontfix

No Milestone

No project

No Assignees

2 Participants

Notifications

Due Date

No due date set.

Dependencies

No dependencies set.

Reference: HswOAuth/llm_course#533

Loading…

Reference in New Issue

Block a user

No description provided.

Delete Branch "%!s()"

Deleting a branch is permanent. Although the deleted branch may continue to exist for a short time before it actually gets removed, it CANNOT be undone in most cases. Continue?

oneapi中配置ollama模型,在终端中可以使用ollama启动模型,但是在oneapi中就会报错,如下图

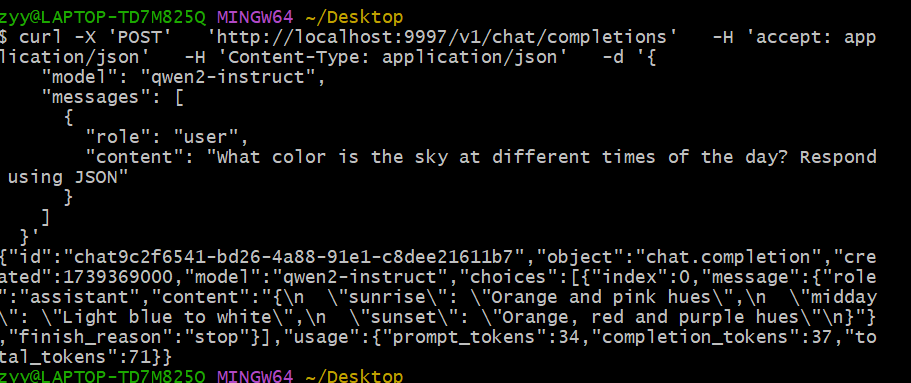

先尝试使用curl命令发送请求测试ollama是否可以访问

类似这种:

curl http://localhost:11434/api/generate -d '{"model": "llama3.2","prompt": "What color is the sky at different times of the day? Respond using JSON","format": "json","stream": false}'测试正常的

我现在是在自己的服务器上使用ollama部署了模型,使用xinference启动了模型;我在本地使用curl ...测试了都是通的。但是在oneapi中就拒绝连接。

下图是xinference启动的模型在oneapi中的配置,这应该怎样处理呢

可以看下oneapi镜像里面的错误信息,看下什么问题

运行界面如下:

渠道配置如下:

终端curl测试如下

老师您看看

你描述下oneapi如何部署的吧,我没看出来有什么问题,可能需要到fastgpt代码库的issues里面去提问,问下开发者这是否是一个bug。

按照图片中得方式部署的。好的,我再看看