求助贴 L2-第一课13-24.9.3-Chinese LLaMA Alpaca系列模型OpenAI API调用实现-Ray老师 #299

Labels

No Label

bug

duplicate

enhancement

help wanted

invalid

question

wontfix

No Milestone

No project

No Assignees

5 Participants

Notifications

Due Date

No due date set.

Dependencies

No dependencies set.

Reference: HswOAuth/llm_course#299

Loading…

Reference in New Issue

Block a user

No description provided.

Delete Branch "%!s()"

Deleting a branch is permanent. Although the deleted branch may continue to exist for a short time before it actually gets removed, it CANNOT be undone in most cases. Continue?

在windows机器上 安装大模型,本机无GPU,内存16G,跑大模型前利用率50%,最后执行:python C:\Users\gaowuyang\Chinese-LLaMA-Alpaca-3-3.0\scripts\oai_api_demo\openai_api_server.py --only_cpu --base_model C:\Users\gaowuyang.cache\modelscope\hub\ChineseAlpacaGroup\llama-3-chinese-8b-instruct-v3

Loading checkpoint shards: 0%| ,进度一直是0,然后就退出了。

重试也是如此(附件截图一)

请问是什么原因,应如何解决?

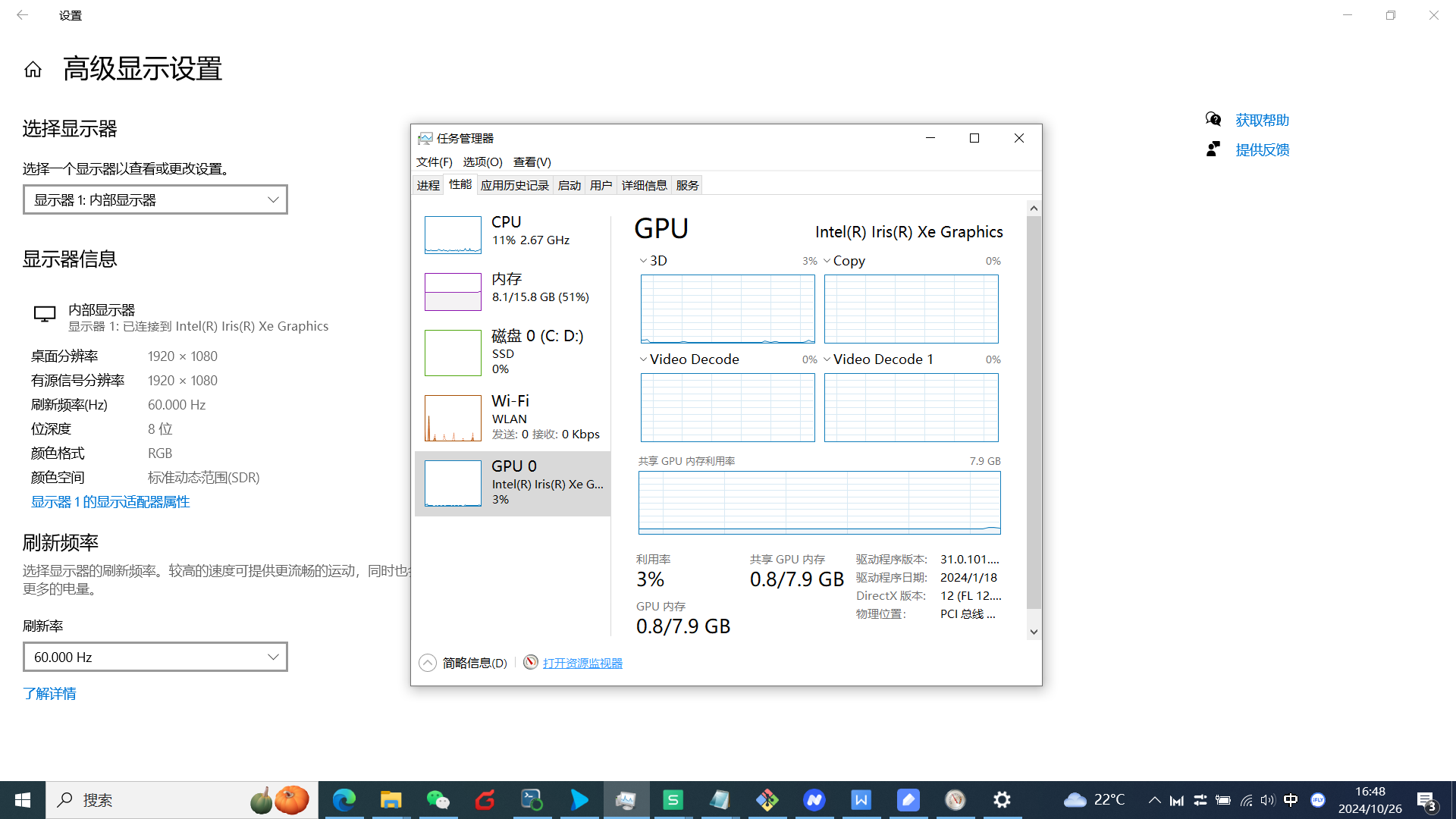

另外,我的华为笔记本电脑也有显存(附件截图二),8G ,是否能用GPU 版本来跑?

截图的问题应该就是这台Windows机器的性能不够。

可以尝试用华为笔记本电脑的GPU来跑。

但需要注意实验环境都是Linux系统,所以需要准备Linux系统的电脑或者服务器。

已经尝试用GPU来跑,但是结果用的还是CPU,是否要修改requriments.txt文件。我看之前配置都是NVVID的显卡,我电脑上的显卡要怎么配置?

nvidia-cublas-cu12==12.1.3.1 nvidia-cuda-cupti-cu12==12.1.105 nvidia-cuda-nvrtc-cu12==12.1.105 nvidia-cuda-runtime-cu12==12.1.105 nvidia-cudnn-cu12==8.9.2.26 nvidia-cufft-cu12==11.0.2.54 nvidia-curand-cu12==10.3.2.106 nvidia-cusolver-cu12==11.4.5.107 nvidia-cusparse-cu12==12.1.0.106 nvidia-nccl-cu12==2.18.1

nvidia-nvjitlink-cu12==12.4.127 nvidia-nvtx-cu12==12.1.105

刚跑起来了,但是客户端提示还是有问题,我看NEXTCHAT 配置也是正确的。请问是什么原因

跑起来了客户端显示是什么样?客户端提示有问题具体是什么问题?可以提供更清晰的截图吗

接口地址,不应该是http://0.0.0.0:19327 吧?应该是你大模型部署所在的机器的ip,如果是本机,应该是http://127.0.0.1:19327

改成(http://127.0.0.1:19327) 是可以了。但是确实CPU性能不够,回答一个简单的问题,要10分钟。我本机的GPU能用吗,如何配置

可以尝试用华为笔记本电脑的GPU来跑。

但需要注意实验环境都是Linux系统,所以需要准备Linux系统的电脑或者服务器。

之前没装linux 。 Windows 上装 ubuntu20.04 可以吧

可以的

还有个问题,CPU 版本 可以支持量化吗?

CPU的版本不支持量化的